Vorsicht: Der Einsatz von ChatGPT verstößt aktuell gegen den Datenschutz

Ohne Zweifel wird der Einsatz von Tools wie ChatGPT bereits sehr kurzfristig für viele Unternehmen erhebliche Erleichterungen bringen. Aktuell steht ChatGPT aber im Kreuzfeuer der Datenschützer. Tatsächlich wirft ChatGPT viele problematische Datenschutzfragen auf. Wir geben einige Antworten und Empfehlungen, wie ChatGPT trotz erheblicher Datenschutzbedenken möglichst risikoarm eingesetzt werden kann.

Inhaltsverzeichnis

- ChatGPT - Was ist das eigentlich genau?

- Die Nutzung von personenbezogene Daten bei ChatGPT

- ChatGPT ist sich der datenschutzrechtlichen Problematik bewusst

- Datenschutzbehörden verbieten aktuell den Einsatz von ChatGPT

- Datenschutzrechtliche Zulässigkeit des Einsatzes von ChatGPT

- VI. Für Mandanten: Aktuelle Empfehlungen zum Einsatz von ChatGPT

- Fazit

ChatGPT - Was ist das eigentlich genau?

ChatGPT ist eine Software des US-amerikanischen Unternehmens OpenAI, mit der Nutzer per Chats kommunizieren können, um verschiedene Informationen generieren bzw. zusammenstellen zu lassen. Während „Chat“ ein Hinweis auf die Nutzungsweise der Software ist, ist der Namensbestandteil „GPT“ eine Abkürzung für „Generative Pre-trained Transformer“ (ins Deutsche übersetzt: „generative vortrainierte Transformatoren“) und deutet auf die Entstehungsweise bzw. Entwicklungsgeschichte von ChatGPT hin.

Software wie „ChatGPT“ wird allgemein als künstliche Intelligenz (KI; im Englischen: artificial intelligence = AI) oder deren Funktionsweise auch als maschinelles Lernen (ML) bezeichnet, weil sie im Rahmen ihrer Entwicklung mit vielen verschiedenen Informationen - im Fall von ChatGPT wohl mit Stand des Jahres 2021 - gefüttert wird, die sie hinsichtlich Sprachmuster, Gesetzmäßigkeiten und sonstiger Muster auswertet und dadurch „lernt“.

Die erste öffentlich zugängliche Version von ChatGPT ist im November 2022 als kostenlose Beta-Version veröffentlicht worden. Gegen Vergütung kann zudem eine kommerzielle Version von ChatGPT genutzt werden, wodurch Unternehmen ChatGPT mittels einer Programmierschnittstelle (API) in die Infrastruktur des eigenen Unternehmens einbinden kann, etwa als Chatbot im Bereich der Kundenkommunikation.

Seit März 2023 ist ChatGPT in der Version GPT-4 verfügbar, in der die Software nach Angaben ihres Anbieters deutlich längere Texte, mehrere Milliarden Parameter und Bilder oder Audio als Inputquelle verarbeiten kann. So soll ChatGPT etwa auch erkennen, beschreiben und weitergehend verarbeiten können, was auf eingegeben Fotos zu sehen ist.

Die Nutzung von personenbezogene Daten bei ChatGPT

Vor dem Hintergrund des aktuell geltenden Datenschutzrechts, insbesondere gemäß der Vorgaben der Datenschutz-Grundverordnung (DSGVO), ist eine dialogbasierte Software maschinellen Lernens wie ChatGPT mindestens aus vier Gründen problematisch.

- Personenbezogene Daten beim ursprünglichen Lernen der KI: Abhängig von der konkreten Programmierung der KI lernt sie aus allen Quellen, zu denen sie Schnittstellen hat und die sie auswerten kann. Typischerweise ist dabei nicht vorgesehen, dass die KI personenbezogene Daten beim Lernen ausspart - sie kann personenbezogene Daten in der Regel nicht einmal von nicht-personenbezogenen Daten unterscheiden. Beim Lernen werden personenbezogene Daten verarbeitet, wofür aus Datenschutzsicht eine hinreichende Rechtsgrundlage vorliegen muss, die aber nicht sofort erkennbar ist.

- Personenbezogene Daten bei Eingaben von Nutzern: Geben Nutzer bei der Nutzung von ChatGPT personenbezogene Daten ein, damit ChatGPT hierzu Ergebnisse ausspuckt, etwa in Form von Namen und Adressen, von Bildern, auf denen Personen abgebildet sind, oder von sonstigen sensitiven Informationen, die auf Personen bezogen sind, geben die Nutzer personenbezogene Daten an den Anbieter von ChatGPT weiter, wozu sie nach den datenschutzrechtlichen Vorgaben auch ausdrücklich befugt sein müssten.

- Personenbezogene Daten beim Weiterlernen der KI: Grundsätzlich versteht sich eine KI nicht als in sich geschlossenes, statisches System, sondern als eine dynamische Software, die sich stetig - auch während des Betriebs - weiterentwickelt. So ist es je nach Programmierung und Algorithmus einer KI gut möglich, dass sie die personenbezogenen Daten, die Nutzer im Rahmen des Chats eingeben, speichert und zur eigenen Weiterentwicklung verwendet.

- Transparenz bei der Verarbeitung von personenbezogenen Daten: Das Datenschutzrecht gibt vor, dass die für die Datenverarbeitung Verantwortlichen in transparenter Weise die betroffenen Personen, deren Daten verarbeitet werden, nach bestimmten Regeln über die Datenverarbeitung informieren müssen. Aufgrund des nicht öffentlichen Algorithmus von KI bzw. der Komplexität der Verarbeitungsvorgänge einer KI ist es in der Praxis kaum möglich, klar und deutlich darüber zu informieren, ob und ggf. auf welche Weise die KI personenbezogene Daten verarbeitet.

ChatGPT ist sich der datenschutzrechtlichen Problematik bewusst

Dieses datenschutzrechtliche Spannungsfeld ist dem Anbieter von ChatGPT bzw. der Software selbst durchaus bewusst.

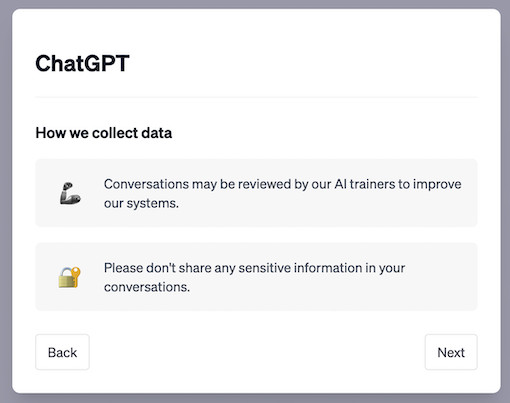

Dies zeigen zum einen die diesbezüglichen ausdrücklichen Instruktionen, die Nutzern bei der Registrierung für die kostenlose Nutzung von ChatGPT angezeigt werden:

Somit sollen sensitive Informationen bei den Konversationen mit ChatGPT ausdrücklich nicht in die Software eingegeben werden. Das Hochladen von Fotos, auf denen Personen abgebildet sind, fällt damit schon einmal heraus. Technisch ausgeschlossen bzw. sichergestellt wird dies aber nicht.

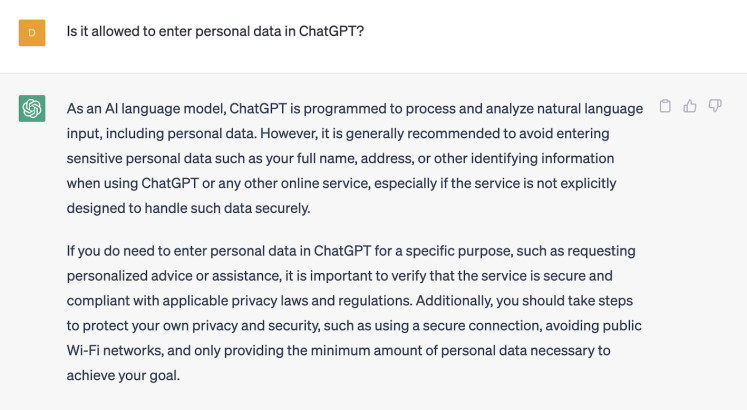

Fragt man ChatGPT direkt, ob es erlaubt ist, personenbezogene Daten bei ChatGPT einzugeben, antwortet der Chatbot zudem so:

Ins Deutsche übersetzt heißt dies:

"Als KI-Sprachmodell ist ChatGPT so programmiert, dass es Eingaben in natürlicher Sprache verarbeitet und analysiert, einschließlich personenbezogener Daten. Es wird jedoch generell empfohlen, die Eingabe von sensible personenbezogenen Daten wie Ihren vollständigen Namen, Ihre Adresse oder andere identifizierende Informationen zu vermeiden, wenn Sie ChatGPT oder einen anderen Online-Dienst nutzen, insbesondere wenn der Dienst nicht ausdrücklich für den sicheren Umgang mit solchen Daten ausgelegt ist."

"Wenn Sie für einen bestimmten Zweck personenbezogene Daten in ChatGPT eingeben müssen, wie z.B. um eine persönliche Beratung oder Hilfe anzufordern, ist es wichtig zu überprüfen, ob der Dienst sicher ist und mit den geltenden Datenschutzgesetzen und -vorschriften übereinstimmt. Außerdem sollten Sie Maßnahmen ergreifen, um Ihre eigene Privatsphäre und Sicherheit zu schützen, z. B. indem Sie eine sichere Verbindung verwenden, öffentliche Wi-Fi-Netzwerke meiden und nur so viele personenbezogene Daten wie nötig angeben, um Ihr Ziel zu erreichen."

ChatGPT selbst weist somit ausdrücklich auf diese Problematik hin und empfiehlt, die jeweils geltenden Datenschutzgesetze zu beachten. Nach Ansicht vieler Datenschützer, insbesondere auch von Datenschutzbehörden, ist eine datenschutzkonforme Nutzung von ChatGPT aktuell allerdings nicht möglich.

Datenschutzbehörden verbieten aktuell den Einsatz von ChatGPT

1. Die italienische Datenschutzbehörde

Die italienische Datenschutzbehörde „Garante per la protezione dei dati personali“ hat in einer auf ihrer Website veröffentlichten Pressemitteilung vom 31. März 2023 bekannt gegeben, ChatGPT in Italien aus datenschutzrechtlichen Gründen gestoppt zu haben. Von Italien kann ChatGPT aktuell daher nicht genutzt werden.

Nach Ansicht der italienischen Behörde würden durch ChatGPT personenbezogene Daten unrechtmäßig gesammelt, auch gebe es kein Altersverifikationssystem für Kinder. Die Behörde verhängte eine sofortige vorübergehende Einschränkung der Verarbeitung der Daten italienischer Nutzer durch OpenAI, den Anbieter von ChatGPT. Außerdem leitete sie eine weitergehende Untersuchung des Sachverhalts ein.

In ihrer Anordnung betont die Behörde, dass den Nutzern von ChatGPT und den betroffenen Personen, deren Daten durch den Anbieter OpenAI gesammelt werden, keine hinreichenden Informationen hierüber zur Verfügung gestellt würden. Zudem gebe es nach Ansicht der Behörde keine Rechtsgrundlage für die massive Sammlung und Verarbeitung personenbezogener Daten, um die Algorithmen zu "trainieren“. Auch würden Tests zeigen, die ChatPGT teilweise auch unrichtige personenbezogene Daten verarbeiten würde. Im Übrigen fehle bei ChatGPT ein Mechanismus zur Altersüberprüfung, so dass Kinder Antworten erhalten können, die ihrem Alter und ihrem Bewusstsein nicht angemessen seien, obwohl sich ChatGPT laut den Nutzungsbedingungen angeblich auch an Nutzer über 13 Jahren richtet, also auch von Kindern genutzt werden dürfe.

Schließlich berichtet die italienische Datenschutzbehörde davon, dass am 20. März 2023 eine Datenpanne gemeldet worden sei, die die Unterhaltungen der ChatGPT-Nutzer und die Informationen über die Zahlungen der Abonnenten des Dienstes betraf.

OpenAI muss der italienischen Datenschutzbehörde nun kurzfristig die Maßnahmen mitteilen, die ergriffen wurden, um der Anordnung der Behörde nachzukommen. Andernfalls drohen Geldstrafe von bis zu 20 Mio. EUR oder 4 % des gesamten weltweiten Jahresumsatzes von OpenAI, je nachdem, welcher Betrag höher ist.

2. Die deutschen Datenschutzbehörden

Anfang April 2023 teilte der Bundesbeauftragte für den Datenschutz in Deutschland mit, dass ein vergleichbares Vorgehen, also auch ein Verbot bzw. eine Sperre der Nutzung von ChatGPT auch in Deutschland möglich sei.

Allerdings hat dies nicht der Bundesbeauftragte für den Datenschutz zu entscheiden, sondern die hierfür zuständige Landesdatenschutzbehörde auf Länderebene.

Aktuell werden wohl weiterführende Informationen von der italienischen Datenschutzbehörde angefragt und anschließend durch die zuständige bzw. ggf. zuständigen Landesbehörden ausgewertet. Mit einer schnellen Entscheidung durch deutsche Datenschutzbehörden ist in nächster Zeit daher nicht unbedingt zu rechnen. Vorerst bleibt die Nutzung von ChatGPT für Nutzer aus Deutschland daher weiterhin möglich.

3. Die englische Datenschutzbehörde

Nach Ansicht der englischen Datenschutzbehörde („Information Commissioner’s Office“; „ICO“) müssen Unternehmen und andere Organisationen, die generative KI - wie ChatGPT - entwickeln oder einsetzen, ihre datenschutzrechtlichen Pflichten von Anfang an berücksichtigen und einen Ansatz des Datenschutzes durch Design und durch Voreinstellung („privacy by design and by default“) verfolgen. Wenn eine KI personenbezogene Daten verarbeitet, sei dies nicht optional, sondern gesetzlich vorgeschrieben.

Das Datenschutzrecht gelte auch dann, wenn die verarbeiteten personenbezogenen Daten aus öffentlich zugänglichen Quellen stammen, also wenn die KI beim Lernen nur öffentliche Quellen ausgewertet hat. Unternehmen, die eine KI entwickeln oder verwenden, die personenbezogene Daten verarbeitet, müssten sich nach Ansicht der englischen Datenschutzbehörde u.a. immer die folgenden Fragen stellen:

- Auf welcher gesetzlichen Rechtsgrundlage werden die personenbezogenen Daten verarbeitet?

- Ist das eigene Unternehmen für die Verarbeitung der personenbezogenen Daten Verantwortlicher, ein sog. gemeinsamer Verantwortlicher oder ein Auftragsverarbeiter?

- Wie sorgt das Unternehmen für hinreichende Transparenz, d.h. wie informiert sie über die erfolgenden Datenverarbeitungen?

- Wie werden unnötige, d.h. übermäßige Datenverarbeitungen eingeschränkt?

- Wie werden Unternehmen die Anfragen zu Betroffenenrechten von betroffenen Personen erfüllen, etwa Anfragen auf Auskunft über die Datenverarbeitung?

Unternehmen, die diese und weitere Fragen nicht oder nicht rechtssicher beantworten können, sollten betreffende KI-Applikationen nach Ansicht der englischen Datenschutzaufsicht nicht einsetzen.

4. Der Europäische Datenschutzausschuss (EDSA)

Am 13. April 2023 hat nun auch der Europäische Datenschutzausschuss („EDSA“; im Englischen: "European Daten Protection Board" = „EDPB“) - das ist die Datenschutzbehörde auf EU-Ebene, über die die einzelnen Datenschutzbehörden in den EU-Mitgliedstaaten koordiniert werden - offiziell mitgeteilt, dass die Mitglieder des Datenschutzausschusses über ChatGPT diskutieren würden.

Zudem haben sich die Mitglieder dazu entschieden, eine spezielle Task Force einzurichten, um die Zusammenarbeit der Datenschutzbehörden aus den einzelnen EU-Mitgliedstaaten zu fördern und Informationen über mögliche datenschutzrechtliche Durchsetzungsmaßnahmen auszutauschen, die die Datenschutzbehörden durchführen könnten. Es kann somit davon ausgegangen werden, dass es schon bald zu weiteren Einschätzungen und Ankündigungen durch Datenschutzbehörden kommen wird.

Datenschutzrechtliche Zulässigkeit des Einsatzes von ChatGPT

Alleine schon wegen der gegenwärtig skeptischen und ablehnenden Haltung führender Datenschutzbehörden ist der Einsatz von ChatGPT aktuell für Unternehmen aus datenschutzrechtlicher Sicht riskant, da jedenfalls mit Maßnahmen durch Aufsichtsbehörden gerechnet werden muss, etwa aufgrund von einzelnen Beschwerden.

Aber auch der Blick auf die zwingenden datenschutzrechtlichen Vorgaben der DSGVO bestätigt, dass viele Aspekte von ChatGPT und ähnlichen KI-basierten Chatbots tatsächlich mit dem Datenschutz in Konflikt geraten.

1. Datenschutzrechtliche Rechtmäßigkeit

Wegen der Ausgestaltung des Datenschutzrechts in der DSGVO als Verbot mit Erlaubnisvorbehalt bedarf jede Datenverarbeitung einer gesetzlichen Erlaubnis, d.h. einer Rechtsgrundlage. Eine solche ist nach dem aktuellen Verständnis der Rechtsgrundlagen in der DSGVO, die insbesondere in Art. 6 DSGVO geregelt sind, kaum erkennbar.

Möglich wäre eine Rechtfertigung nach Art. 6 Abs. 1 S. 1 Buchst. f DSGVO, wonach die Verarbeitung von personenbezogenen Daten zulässig ist, soweit sie zur Wahrung der berechtigten Interessen des Verantwortlichen oder eines Dritten erforderlich ist, sofern wiederum nicht die Interessen oder Grundrechte und Grundfreiheiten der betroffenen Person, die den Schutz personenbezogener Daten erfordern, überwiegen, insbesondere dann, wenn es sich bei der betroffenen Person um ein Kind handelt.

Wichtige Aspekte, die bei der Abwägung der Interessen zu berücksichtigen sind, betreffen die Art der verarbeiteten personenbezogenen Daten und deren Umfang und Ausmaß sowie die Transparenz, dass dies für die betroffenen Personen aus ihrem Blickwinkel eingeschätzt werden kann, insbesondere um ggf. ihre Betroffenenrechte wahrzunehmen, etwa der Datenverarbeitung zu widersprechen. Da dies bei ChatGPT aktuell nicht transparent nachvollziehbar ist, fällt es aus objektiver Sicht schwer, die Abwägung der Interessen nicht zu Gunsten der betroffenen Personen ausfallen zu lassen.

2. Verarbeitung von Daten in unsicheren Drittländern

Die Server von ChatGPT stehen nach aktuellem Kenntnisstand - zumindest auch - in den USA. Werden personenbezogene Daten durch Eingabe in das Chatsystem an diese Server übermittelt, ist dies daher wahrscheinlich auch mit der Verarbeitung von personenbezogenen Daten in den USA oder ggf. auch in anderen - aus Sicht des europäischen Datenschutzes - unsicheren Drittstaaten verbunden.

Nach der gegenwärtigen Rechtslage ist eine Übermittlung von personenbezogenen Daten in die USA und Verarbeitung dort aber kaum bzw. jedenfalls nur bei Vorliegen bestimmter, schwer zu erfüllender Voraussetzungen gegeben. Auch deswegen dürfte es Unternehmen kaum gelingen, die Rechtmäßigkeit der Nutzung von ChatGPT im Unternehmensalltag nachzuweisen.

3. Transparenzgebot: Hinweise in der Datenschutzerklärung

Unternehmen müssen in ihrer Datenschutzerklärung nach Art 13 DSGVO in transparenter Weise über die von ihnen vorgenommenen Verarbeitungen von personenbezogenen Daten umfassend und präzise informieren.

Buchen Sie gerne noch heute eines unserer Schutzpakete, um Ihren Webshop oder die Website Ihres Unternehmens mit abmahnsicheren Rechtstexten rechtlich abzusichern. Sprechen Sie uns hierzu zudem gerne jederzeit an, wenn Sie hierzu noch Fragen haben.

Wenn Unternehmen selbst aber nicht so genau wissen, was das von ihnen eingesetzte Tool ChatGPT eigentlich mit den personenbezogenen Daten macht, können sie in der Folge auch nicht hinreichend in ihrer Datenschutzerklärung darüber informieren, ihren DSGVO-Transparenzpflichten also nicht nachkommen.

4. Abschluss eines Auftragsverarbeitungsvertrags nach Art. 28 DSGVO?

Übermittelt ein datenschutzrechtlich Verantwortlicher personenbezogene Daten an einen Dienstleister, der im Rahmen eines konkreten Auftrags des Verantwortlichen diese Daten verarbeiten soll, sieht die Datenschutz-Grundverordung in Art. 28 DSGVO hierfür verpflichtend den Abschluss eines Auftragsverarbeitungsvertrags zwischen dem Verantwortlichen und dem Auftragsverarbeiter vor, der inhaltlich den Vorgaben aus Art. 28 DSGVO entsprechen muss. Typische Beispiele hierfür ist die Nutzung eines externen Cloud-Speichers eines Dienstleisters.

Wenn Unternehmen an ChatGPT personenbezogene Daten übermitteln, so dass die KI diese verarbeitet, um dem Unternehmen daraus nützliche Erkenntnisse oder sonstige Ergebnisse zu generieren und zu liefern, muss daher möglicherweise ein solcher Auftragsverarbeitungsvertrag abgeschlossen werden. Bei der kostenfreien Nutzung ist dies bei ChatGPT aber nicht vorgesehen. Ob der Auftragsverarbeitungsvertrag, der Nutzern offenbar bei Buchung der kostenpflichtigen API zu ChatGPT zum Abschluss angeboten wird, den datenschutzrechtlichen Vorgaben vollständig genügt, ist aktuell offen.

Außerdem ist überhaupt unklar, ob aufgrund der Art der Datenverarbeitung durch ChatGPT und ihres Umfanges aus datenschutzrechtlicher Sicht überhaupt eine Auftragsverarbeitung i.S.d. Art. 28 DSGVO vorliegt oder nicht vielleicht eine sog. gemeinsame Verantwortlichkeit von OpenAI, dem Anbieter von ChatGPT, und dem Unternehmen, das ChatGPT nutzt. In diesem Fall würde die DSGVO weitere Voraussetzungen vorsehen, die ChatGPT aktuell nicht erfüllen kann, wie etwa den Abschluss einer besonderen Vereinbarung über die gemeinsame Verantwortlichkeit.

VI. Für Mandanten: Aktuelle Empfehlungen zum Einsatz von ChatGPT

Mag eine rein private Nutzung von ChatGPT - als Spielerei - aus rechtlicher Sicht unbedenklich sein, gilt dies für den kommerziellen Einsatz im Business-Alltag von Unternehmen aktuell sicherlich nicht.

Unternehmen, die - aus grundsätzlich nachvollziehbaren Gründen - dennoch nicht auf den Einsatz von ChatGPT verzichten wollen, empfehlen wir aus datenschutzrechtlicher Sicht dringend, zumindest folgende Punkte zu beachten, um das datenschutzrechtliche Risiko und das Risiko von Konsequenzen zumindest zu mindern:

Exklusiv-Inhalt für Mandanten

Noch kein Mandant?

-

WissensvorsprungZugriff auf exklusive Beiträge, Muster und Leitfäden

-

Schutz vor AbmahnungenProfessionelle Rechtstexte – ständig aktualisiert

-

Monatlich kündbarSchutzpakete mit flexibler Laufzeit

Fazit

Tools wie ChatGPT oder andere Anwendungen künstlicher Intelligenz bzw. maschinellen Lernens gehört eindeutig die Zukunft, auch bereits sehr kurzfristig. Solche Entwicklungen sind erfahrungsgemäß kaum aufzuhalten, so dass alle Beteiligten mit ihnen umgehen müssen.

Der Konflikt mit dem geltenden Datenschutzrecht ist allerdings offensichtlich und zeigt sich besonders an den strengen behördlichen Maßnahmen der Datenschutzbehörden, so dass Unternehmen den Einsatz solcher Tools sorgsam abwägen müssen. Einerseits dürfen aktuelle Entwicklungen nicht verschlafen werden, um nicht von etwas mutigeren Mitbewerbern abgehängt zu werden. Andererseits sollten keine unnötigen Risiken eingegangen werden, die kostspielige Folgen haben könnten - etwa in Form von Untersagungen, Geldbußen, Abmahnungen durch Mitbewerber oder Verbände oder auch Schadensersatzforderungen von betroffenen Personen.

Die von uns in diesem Beitrag aufgezeigten Möglichkeiten, das datenschutzrechtliche Risiko zu minimieren, können dabei helfen, den aufgezeigten Spagat zu meistern. Ein völlig risikoloser Einsatz ist dabei aktuell aber nicht möglich. Händler und Unternehmen, die ChatGPT - etwa als Chatbot in der Kundenkommunikation oder in anderen Anwendungsgebieten - einsetzen möchten, sollten unbedingt die aktuellen datenschutzrechtlichen Entwicklungen beobachten. Selbstverständlich halten wir unsere Mandanten bei diesem Thema auf dem Laufenden.

Fragen zum Beitrag? Diskutieren Sie hierzu gerne mit uns in der Unternehmergruppe der IT-Recht Kanzlei auf Facebook.

Link kopieren

Als PDF exportieren

Per E-Mail verschicken

Zum Facebook-Account der Kanzlei

Zum Instagram-Account der Kanzlei

2 Kommentare